Viele Betriebe nutzen KI deutlich vorsichtiger, als sie müssten. Nicht, weil kein Interesse da ist. Sondern weil Datenschutz im Raum steht.

Die typische Situation:

Mitarbeitende nutzen ChatGPT heimlich oder halb offiziell für Texte. Die Geschäftsführung weiß, dass KI helfen könnte. Gleichzeitig traut sich niemand, Kundendaten, Angebote oder interne Dokumente zu verwenden. Also bleibt es bei allgemeinen Prompts und Spielerei.

Das ist verständlich. Aber es ist kein guter Dauerzustand.

KI-Nutzung braucht keine Angst, sondern klare Regeln.

Warum “einfach nichts machen” keine gute Strategie ist

Wenn Unternehmen KI nicht aktiv regeln, entsteht Schattennutzung. Mitarbeitende probieren Tools trotzdem aus, aber ohne Leitplanken.

Dann landen schnell Daten in Systemen, in die sie nicht gehören:

- Kundennamen

- Projektunterlagen

- Verträge

- Gehaltsinformationen

- interne Kalkulationen

- Zugangsdaten

- vertrauliche E-Mails

Das Risiko entsteht also nicht nur durch KI. Es entsteht durch ungeregelte KI.

Eine klare interne KI-Richtlinie ist oft der erste große Schritt. Sie muss nicht kompliziert sein. Sie muss verständlich sagen, was erlaubt ist, was verboten ist und wann Rücksprache nötig ist.

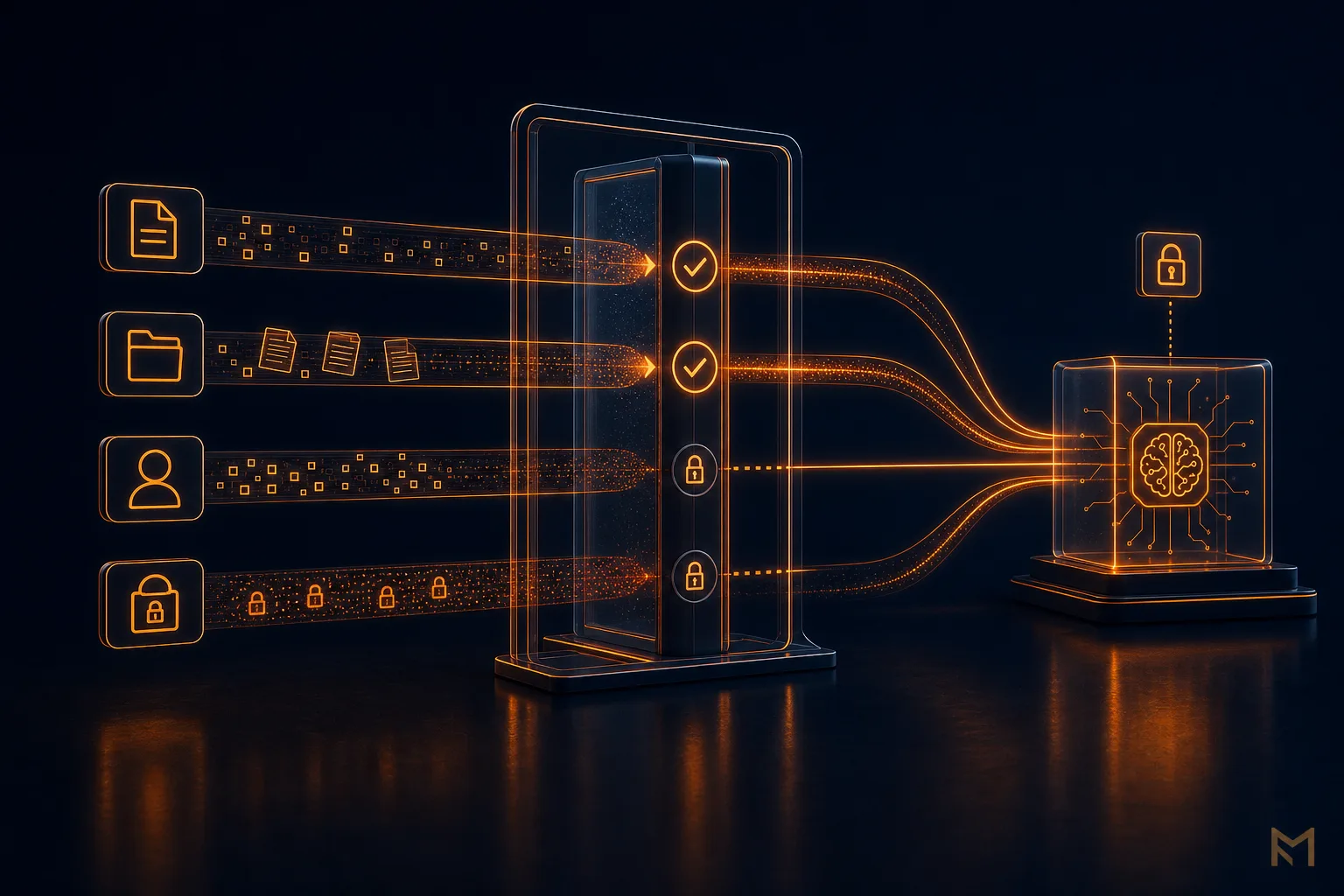

Die wichtigste Unterscheidung: Datenklassen

Statt pauschal zu sagen “KI ist verboten” oder “KI ist erlaubt”, sollten Betriebe Daten in Klassen einteilen.

Klasse 1: Öffentliche Informationen

Beispiele: Website-Texte, Produktbeschreibungen, allgemeine Brancheninformationen, öffentliche Ausschreibungen.

Diese Inhalte können meist gut für Recherche, Entwürfe und Strukturierung genutzt werden.

Klasse 2: Interne, aber nicht sensible Informationen

Beispiele: allgemeine Prozessbeschreibungen, neutrale Vorlagen, interne Checklisten ohne Personenbezug.

Diese Inhalte können häufig genutzt werden, wenn Tool, Zugriff und Zweck klar sind.

Klasse 3: Personenbezogene und vertrauliche Informationen

Beispiele: Kundendaten, Mitarbeiterdaten, Verträge, Preise, Projektkalkulationen, Geschäftsgeheimnisse.

Diese Daten gehören nicht unüberlegt in frei genutzte KI-Tools. Hier braucht es passende Lizenzen, Auftragsverarbeitung, Zugriffskonzepte oder eigene technische Lösungen.

Klasse 4: Kritische Informationen

Beispiele: Passwörter, API-Schlüssel, Bankdaten, Gesundheitsdaten, besonders vertrauliche Unternehmensdaten.

Diese Informationen gehören nicht in allgemeine KI-Chats.

Browser-Chat, Team-Lizenz, API oder eigenes System?

Nicht jede KI-Nutzung ist gleich. Technisch macht es einen großen Unterschied, wie ein Modell genutzt wird.

Browser-Chat mit Einzelkonto: Gut für allgemeine Texte, Ideen, Zusammenfassungen ohne sensible Daten. Kritisch bei Kundendaten oder vertraulichen Unterlagen.

Team- oder Business-Lizenz: Besser für Unternehmen, weil Verwaltung, Datenschutzvereinbarungen und Einstellungen meist sauberer geregelt sind.

API-Nutzung: Häufig sinnvoll für Automatisierung, weil Datenflüsse kontrollierter gebaut werden können.

Eigene Wissensdatenbank oder lokale Komponenten: Sinnvoll, wenn Betriebswissen strukturiert genutzt werden soll und Kontrolle über Daten, Quellen und Rechte wichtig ist.

Die richtige Lösung hängt vom Use-Case ab. Ein Social-Media-Entwurf braucht eine andere Architektur als ein interner Assistent, der Kundenakten durchsucht.

Was Mitarbeitende konkret wissen müssen

Eine KI-Schulung muss nicht akademisch sein. Für den Alltag sind klare Regeln wichtiger als lange Theorie.

Mitarbeitende sollten wissen:

- welche Tools erlaubt sind

- welche Daten sie eingeben dürfen

- welche Daten tabu sind

- wie Ergebnisse geprüft werden

- wann Quellen nötig sind

- wer bei Unsicherheit gefragt wird

- dass KI plausibel klingen und trotzdem falsch liegen kann

Besonders wichtig: KI-Ergebnisse dürfen nicht ungeprüft an Kunden, Behörden oder Bewerber weitergegeben werden.

Warum Datenschutz und Nutzen kein Widerspruch sind

Viele sinnvolle KI-Anwendungen kommen ohne sensible Daten aus.

Beispiele:

- allgemeine E-Mail-Entwürfe

- Textüberarbeitung

- Ideen für Stellenanzeigen

- Zusammenfassungen anonymisierter Notizen

- interne Checklisten

- Vorlagen für Schulungen

- Strukturierung öffentlicher Informationen

Der nächste Schritt ist dann nicht “alles freigeben”, sondern technische und organisatorische Maßnahmen passend zum Use-Case wählen.

Datenschutz ist also kein Stoppschild. Er ist ein Sortiersystem.

Der sichere Einstieg in fünf Schritten

- Erfassen Sie, welche KI-Tools bereits genutzt werden.

- Definieren Sie erlaubte und verbotene Datenarten.

- Legen Sie fest, welche Tools offiziell verwendet werden dürfen.

- Schulen Sie Mitarbeitende mit echten Beispielen aus dem Alltag.

- Prüfen Sie für wertvolle Use-Cases eine eigene Architektur oder API-Lösung.

Damit entsteht ein arbeitsfähiger Rahmen. Nicht perfekt, aber deutlich besser als heimliche Einzelnutzung.

Was IT-Meeder dabei macht

Wir helfen Betrieben, KI-Nutzung praktisch einzuordnen. Das beginnt oft mit einem Workshop: Was ist erlaubt, was nicht, welche Prompts sind sinnvoll, welche Daten bleiben draußen?

Wenn aus der Nutzung ein echtes Projekt werden soll, prüfen wir im Rahmen einer Potenzialanalyse Datenlage, Risiken und technische Umsetzung. Bei Bedarf bauen wir ein eigenes KI-System oder eine Wissensdatenbank, bei der Zugriff, Quellen und Datenflüsse bewusst geplant werden.

Unser Ziel ist nicht, Angst zu machen. Unser Ziel ist, dass Sie KI nutzen können, ohne blind Daten in fremde Systeme zu kopieren.

Häufige Fragen

Darf ich ChatGPT überhaupt geschäftlich nutzen?

Grundsätzlich kann KI geschäftlich genutzt werden. Entscheidend ist, welche Daten verarbeitet werden, welches Konto genutzt wird, welche Vereinbarungen bestehen und ob Mitarbeitende klare Regeln haben.

Reicht es, personenbezogene Daten zu anonymisieren?

Anonymisierung kann helfen, muss aber sauber gemacht werden. Namen zu ersetzen reicht nicht immer, wenn Personen über Kontext trotzdem erkennbar bleiben.

Müssen alle Mitarbeitenden geschult werden?

Alle Personen, die KI im Betrieb einsetzen, sollten ein angemessenes Grundverständnis haben. Das ist nicht nur praktisch sinnvoll, sondern durch neue KI-Regeln auch organisatorisch relevant.

Kann man KI komplett lokal betreiben?

In manchen Fällen ja, aber nicht jeder Use-Case braucht das. Lokale oder stärker kontrollierte Systeme sind besonders interessant, wenn vertrauliches Betriebswissen dauerhaft genutzt werden soll.

Weiterführende Seiten

- IT-Meeder: KI-Workshops

- IT-Meeder: KI-Potenzialanalyse

- IT-Meeder Blog: Eigene KI-Wissensdatenbank